El secretario de Defensa, Pete Hegseth, amenaza con invocar la Ley de Producción de Defensa para obligar a la startup a ceder sus modelos “Claude” para uso militar. La disputa escala ante la negativa de la empresa de permitir misiones letales autónomas y vigilancia masiva.

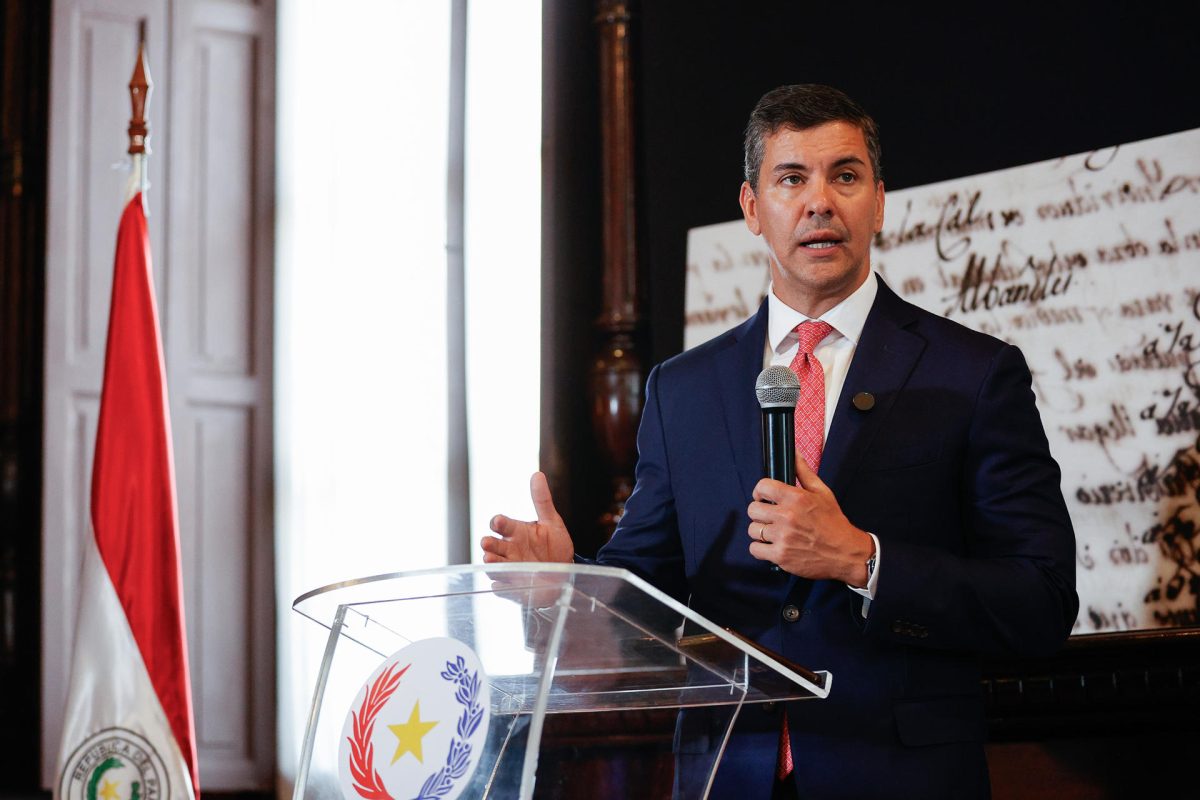

La administración de los Estados Unidos ha decidido elevar la presión sobre el sector tecnológico a niveles sin precedentes. En una reunión de alto voltaje celebrada este martes en Washington, el jefe del Pentágono, Pete Hegseth, lanzó una advertencia directa a Dario Amodei, CEO de Anthropic: o la empresa concede acceso total a su tecnología para fines militares clasificados, o será intervenida bajo leyes de tiempos de la Guerra Fría.

El conflicto: Ética vs. Capacidad Bélica

Anthropic, fundada por exmiembros de OpenAI con una bandera de “IA segura”, se resiste a que su modelo Claude sea utilizado en dos escenarios críticos:

-

Operaciones letales autónomas: Misiones donde la IA decida objetivos militares sin intervención humana.

-

Vigilancia masiva: El uso de sus algoritmos para el monitoreo de ciudadanos dentro de EE. UU.

Sin embargo, el Gobierno no parece dispuesto a aceptar condiciones. Según fuentes del Pentágono, Hegseth baraja invocar la Ley de Producción de Defensa, lo que le permitiría al presidente controlar la producción y el uso de la IA de Anthropic bajo el argumento de “seguridad nacional”.

Antecedentes: El rol de Claude en Venezuela

La tensión no es teórica. Se ha filtrado que el ejército estadounidense ya utilizó capacidades de Claude durante la incursión de 2026 en Venezuela, que culminó con la captura de Nicolás Maduro. Aunque los detalles del uso de la IA en esa operación son secretos, el éxito de la misión parece haber disparado el interés del Pentágono por integrar esta tecnología en el corazón de su cadena de mando.

Un giro en la política de la empresa

Curiosamente, el mismo día de la reunión con el Pentágono, Anthropic publicó un comunicado que marca un viraje en su filosofía. La empresa admitió una “suavización” de sus políticas de seguridad básicas para mantenerse competitiva.

“El entorno político ha cambiado y ahora da prioridad a la competitividad de la IA y al crecimiento económico”, señaló la firma en su blog oficial.

Las consecuencias de un “No”

Si Anthropic mantiene su negativa antes del plazo fijado para este viernes, las repercusiones podrían ser devastadoras para sus finanzas:

-

Exclusión de contratos: Perdería el acceso a contratos multimillonarios con el Departamento de Defensa (solo en 2025 firmó uno por 200 millones de dólares).

-

Intervención estatal: El Gobierno podría forzar el uso de sus modelos independientemente de la voluntad de sus directivos.

Este enfrentamiento marca un nuevo campo de batalla geopolítico donde el código de programación y los valores éticos chocan de frente con las necesidades tácticas de la mayor potencia militar del mundo.